Un client écrit au support : "Où est ma commande ?"

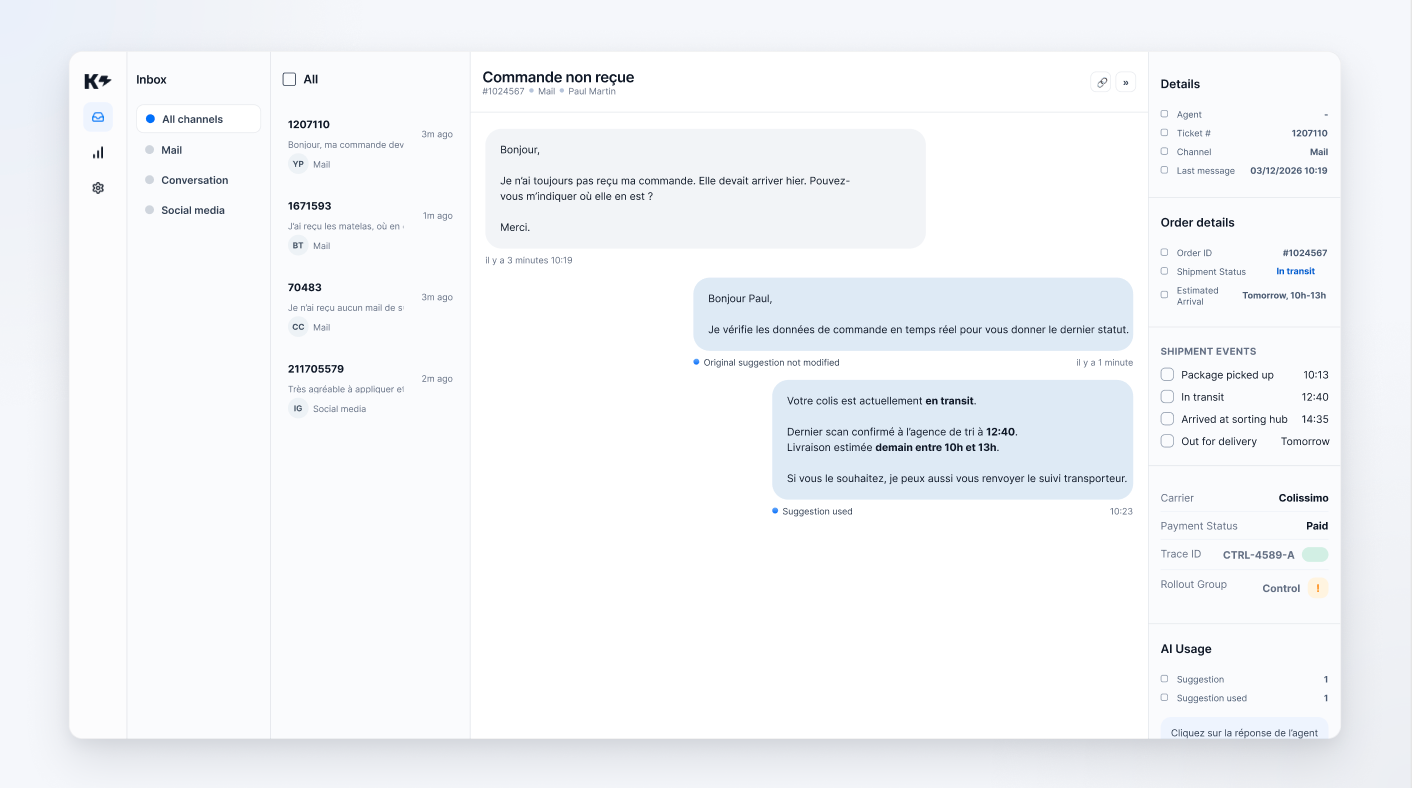

En démo, une IA agentique impressionne vite. Elle comprend la question, appelle une source temps réel, récupère le statut de commande et répond en quelques secondes avec une réponse propre.

En production, c'est rarement aussi simple.

La donnée peut être incomplète. Le contexte client peut manquer. Le modèle peut appeler cette capacité alors qu'il n'en a pas besoin. Ou, plus subtil encore, cet accès temps réel peut être actif mais dégrader la performance au lieu de l'améliorer si le périmètre, les prompts ou les données ne sont pas assez propres.

C'est là que beaucoup d'équipes se trompent. Le sujet n'est pas seulement "est-ce que l'IA sait agir ?". Le vrai sujet est le suivant : dans quel cadre peut-elle agir, avec quelles limites, et comment sait-on qu'elle améliore vraiment le service client ?

Dans cet article, on part d'un cas très concret : un assistant service client capable d'aller chercher des données de commande en temps réel. On s'appuie sur des apprentissages terrain, pas seulement sur des démos : activation progressive, A/B tests, biais d'analyse, garde-fous techniques et observabilité.

Si vous cherchez à déployer une IA agentique en production dans le service client, c'est généralement là que le match se joue.

À retenir en 3 phrases :

Une démo réussit parce qu'elle se déroule dans un environnement propre. Le cas est simple. La donnée est prête. Le contexte est connu. L'outil répond bien. Et personne ne demande ce qui se passe quand l'appel API échoue, quand le client n'est pas reconnu, ou quand l'IA boucle.

La production, elle, pose des questions beaucoup plus exigeantes.

L'outil est-il activé pour tous les clients ou seulement pour certains ? Le modèle sait-il quand appeler cette capacité, et surtout quand ne pas l'appeler ? Que se passe-t-il si la donnée externe est bruitée, partielle ou contradictoire ? Comment mesure-t-on si elle améliore réellement les réponses ? Et comment les équipes support vérifient-elles ce que l'IA a fait ?

Tant que ces questions restent floues, on n'a pas un système de production. On a une belle démonstration.

Prenons un cas simple et fréquent en service client : les demandes "WISMO" (pour Where Is My Order).

Quand un client demande où en est son colis, un chatbot classique donne souvent une réponse générique, ou renvoie vers un lien de suivi. Une IA agentique bien branchée aux données de commande en temps réel (par exemple avec des outils comme Shopify, OneStock, PrestaShop ou d'autres) peut faire autre chose.

Elle peut vérifier le statut, les événements logistiques, l'identifiant de suivi ou certains montants, puis adapter sa réponse au contexte exact du client.

Sur le papier, c'est exactement la promesse attendue.

Dans la vraie vie, ce n'est pas parce qu'une capacité existe que la performance suit immédiatement.

On le voit souvent sur le terrain : au début, les résultats peuvent être plus faibles que prévu, voire moins bons qu'une version sans accès temps réel. Non pas parce que l'idée est mauvaise, mais parce qu'un système agentique dépend de toute la chaîne autour de lui :

Tous ces paramètres ont un impact direct sur les livrables de l'IA.

Autrement dit, une capacité d'accès en temps réel ne crée pas la performance à elle seule. Elle crée une possibilité. La performance vient du système complet.

Une erreur classique consiste à activer cette capacité sur tout le périmètre en même temps.

En pratique, un déploiement sérieux se fait presque toujours de manière progressive. Dans un cas comme l'accès aux commandes en temps réel, l'accès à cette fonctionnalité dépend d'une configuration explicite transmise au modèle, via une logique du type availableTools. Cela permet d'activer ou non certaines capacités selon le client, le périmètre ou la phase de lancement.

Ce point est beaucoup plus important qu'il n'en a l'air.

Vous pouvez tester la fonctionnalité sur un sous-ensemble de clients. Vous pouvez limiter les champs exposés au strict nécessaire. Vous évitez qu'une capacité encore instable soit disponible partout. Et vous corrigez avant généralisation.

En service client, c'est essentiel. Une IA agentique en production ne se déploie pas "d'un coup". Elle se déploie client par client, segment par segment, avec une logique de montée en charge.

C'est aussi comme cela qu'on évite de tirer les mauvaises conclusions. Si vous activez tout partout immédiatement, vous ne savez plus distinguer un problème de prompt, un problème de données, un problème de qualité de groupe test, ou un problème réel de la fonctionnalité elle-même.

Une bonne IA agentique n'appelle pas une source temps réel à chaque message.

Si le client demande "Quels sont vos horaires ?", appeler l'accès commandes n'a aucun sens. Si le client demande "Mon colis devait arriver hier, où en est-il ?", ne pas appeler cette capacité est généralement une erreur.

La valeur de l'IA agentique est là : le modèle lit le contexte de la conversation, détermine s'il a besoin d'une donnée externe, puis décide d'appeler ou non un accès temps réel comme fetch_orders.

Ce comportement change tout par rapport à un workflow figé.

Mais cette autonomie n'est utile que si elle reste encadrée. Sinon, on obtient un système coûteux, imprévisible, voire moins performant qu'une approche plus simple.

La bonne question n'est donc pas "Faut-il laisser le modèle décider ?". La bonne question est la suivante : dans quelles conditions sa décision devient-elle suffisamment fiable, mesurable et réversible pour être acceptable en production ?

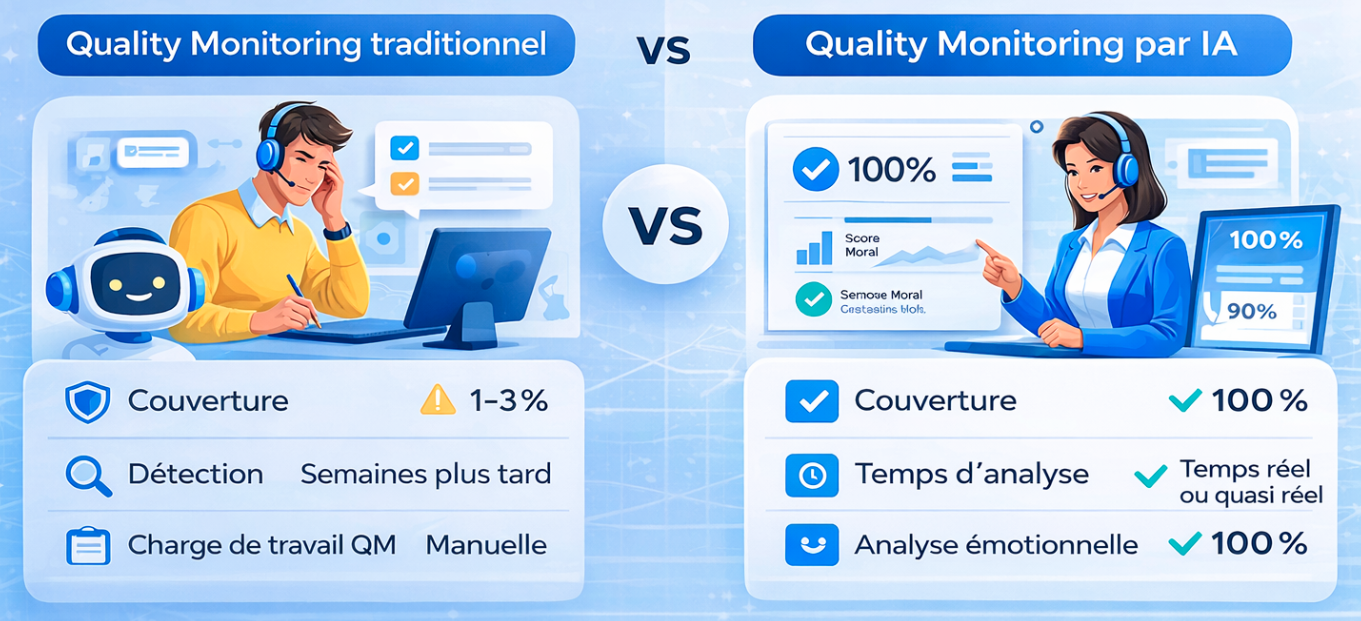

C'est probablement le point le moins intuitif, et pourtant l'un des plus importants.

Sur le terrain, une capacité agentique fraîchement branchée ne surperforme pas toujours immédiatement. Elle peut même, dans un premier temps, faire moins bien qu'un système sans accès temps réel.

Pourquoi ? Parce qu'entre la capacité théorique et la performance réelle, il y a plusieurs couches à stabiliser :

Sans ce travail, on risque de conclure trop vite que "la fonctionnalité ne marche pas", alors que le vrai sujet se situe ailleurs par exemple dans le nettoyage des données ou le cadre d'évaluation, biaisé.

C'est pour cela qu'un bon déploiement agentique repose souvent sur des A/B tests, des lancements partiels sur une fraction du trafic, des itérations sur le prompt, des ajustements du périmètre outil et une relecture fine des cas où la capacité a aidé, raté, ou été appelée inutilement.

Ce travail est moins spectaculaire qu'une démo. Mais c'est lui qui crée l'outil de production.

Quelques signaux à suivre en priorité :

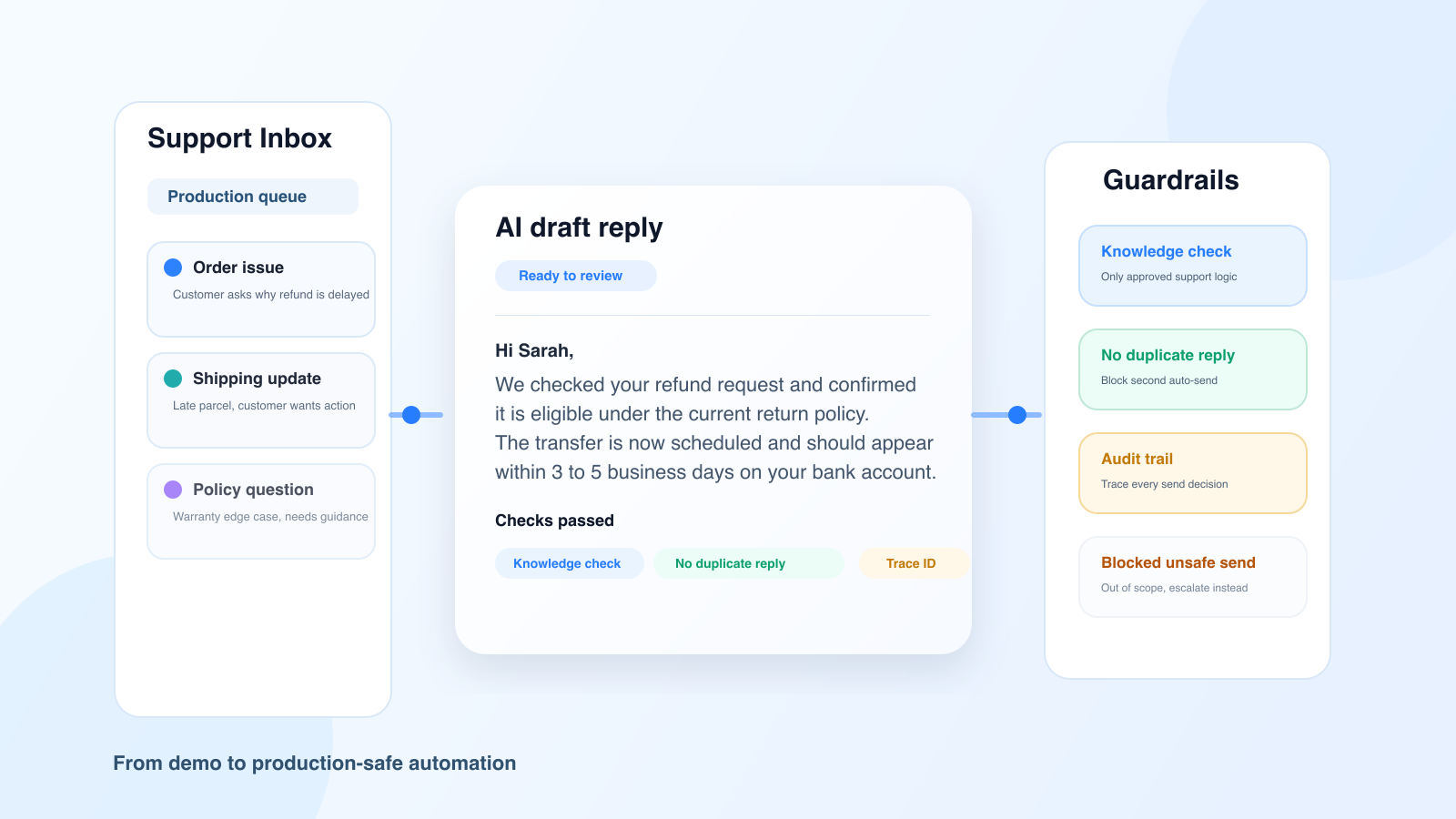

Quand on parle de garde-fous IA, il faut sortir du discours vague.

Dans un système agentique réel, les protections utiles sont concrètes : limite d'itérations pour éviter les boucles, détection des appels répétés avec la même entrée, timeout côté API, erreurs structurées plutôt qu'échecs silencieux et blocage si le contexte client minimal est absent.

Dans le cas d'une capacité d'accès en temps réel aux données de commande, cela veut dire par exemple :

Ce sont ces détails qui transforment une capacité agentique en capacité exploitable. Une IA agentique de production n'a pas besoin d'être parfaite. Elle doit surtout être bornée, prévisible et stoppable.

Une IA agentique qui agit sans laisser de trace crée plus d'inquiétude que de valeur.

Pour qu'un système soit gouvernable, il faut pouvoir répondre à des questions simples : quelle capacité a été appelée, pour quel ticket, avec quel contexte, combien de fois, et avec quel résultat.

Dans un design propre, cela passe par plusieurs niveaux de traçabilité :

tools_used ou tool_calls_count.Ce n'est pas un sujet réservé aux développeurs.

Pour les équipes service client, cette observabilité permet de comprendre pourquoi une réponse a été produite, d'auditer les cas sensibles, de distinguer une réponse fondée sur des données réelles d'une réponse purement générative et de prioriser les vrais problèmes de déploiement.

Une équipe support ne fait pas confiance à une IA parce qu'elle "semble intelligente". Elle lui fait confiance parce qu'elle peut vérifier ce qu'elle a fait.

Vu de loin, l'IA agentique ressemble à un sujet technique. En réalité, c'est très vite un sujet de pilotage opérationnel.

Quand le cadre est bien conçu, les réponses deviennent plus précises sur les commandes, livraisons et remboursements. Le déploiement peut se faire progressivement. Les risques deviennent plus lisibles. Et les équipes comprennent mieux quand l'IA aide vraiment.

Et surtout, la conversation change. On ne débat plus seulement de "l'IA agentique" comme concept. On parle enfin des vraies questions : sur quels cas l'activer, comment la mesurer, comment la corriger, et comment savoir si elle apporte plus qu'elle ne complique.

C'est exactement ce qui distingue une promesse marketing d'une logique de production.

Chez Klark, on ne regarde pas l'IA agentique comme un simple effet de démonstration.

Le vrai enjeu est d'aider les équipes support à gagner du temps et à répondre plus précisément dans leurs outils habituels. Cela suppose une approche beaucoup plus opérationnelle : connecter les bonnes sources de vérité, exposer les bonnes capacités au bon moment, limiter l'autonomie quand le contexte est insuffisant, mesurer les résultats sur des cas réels et faire évoluer le système à partir de ce qui se passe vraiment en production.

C'est pour cela que les sujets de rollout, de garde-fous et d'observabilité sont si centraux chez Klark. Ils sont moins visibles qu'une démo, mais beaucoup plus proches de la vraie vie d'un service client.

Pour approfondir le sujet, vous pouvez aussi lire notre article sur l'IA agentique pour le service client, notre article sur l'Agentic RAG appliqué au service client et notre page Solutions.

Déployer une IA agentique en production ne consiste pas à brancher un modèle sur une source temps réel et espérer que tout se passe bien.

Le vrai travail consiste à activer la bonne capacité au bon périmètre, encadrer les décisions du modèle, limiter les dérives, mesurer honnêtement la performance et comprendre précisément ce que l'IA a fait.

Dans le service client, c'est cette discipline qui fait la différence entre une IA impressionnante en démonstration et une IA réellement utile au quotidien.

À propos de Klark

Klark est une plateforme d'IA générative qui aide les agents du service client à répondre plus vite, plus précisément, sans changer leurs outils ni leurs habitudes. Déployable en quelques minutes, Klark est déjà utilisé par plus de 60 marques et 2 000 agents.