Beaucoup d’équipes support vivent la même scène.

Une démo d’IA génère une réponse fluide, bien tournée, en quelques secondes. Tout le monde se dit alors que l’automatisation du support client par IA est prête.

Puis vient la production. Et là, les vraies questions apparaissent.

La réponse est-elle vraiment conforme à la base de connaissance du client ? L’IA risque-t-elle de partir dans une boucle sans fin, inextricable pour le consommateur ? Est-ce que certains tickets doivent sortir du scope automatique ? Comment auditer ce qui a été envoyé et comprendre ce qui marche et ne marche pas ?

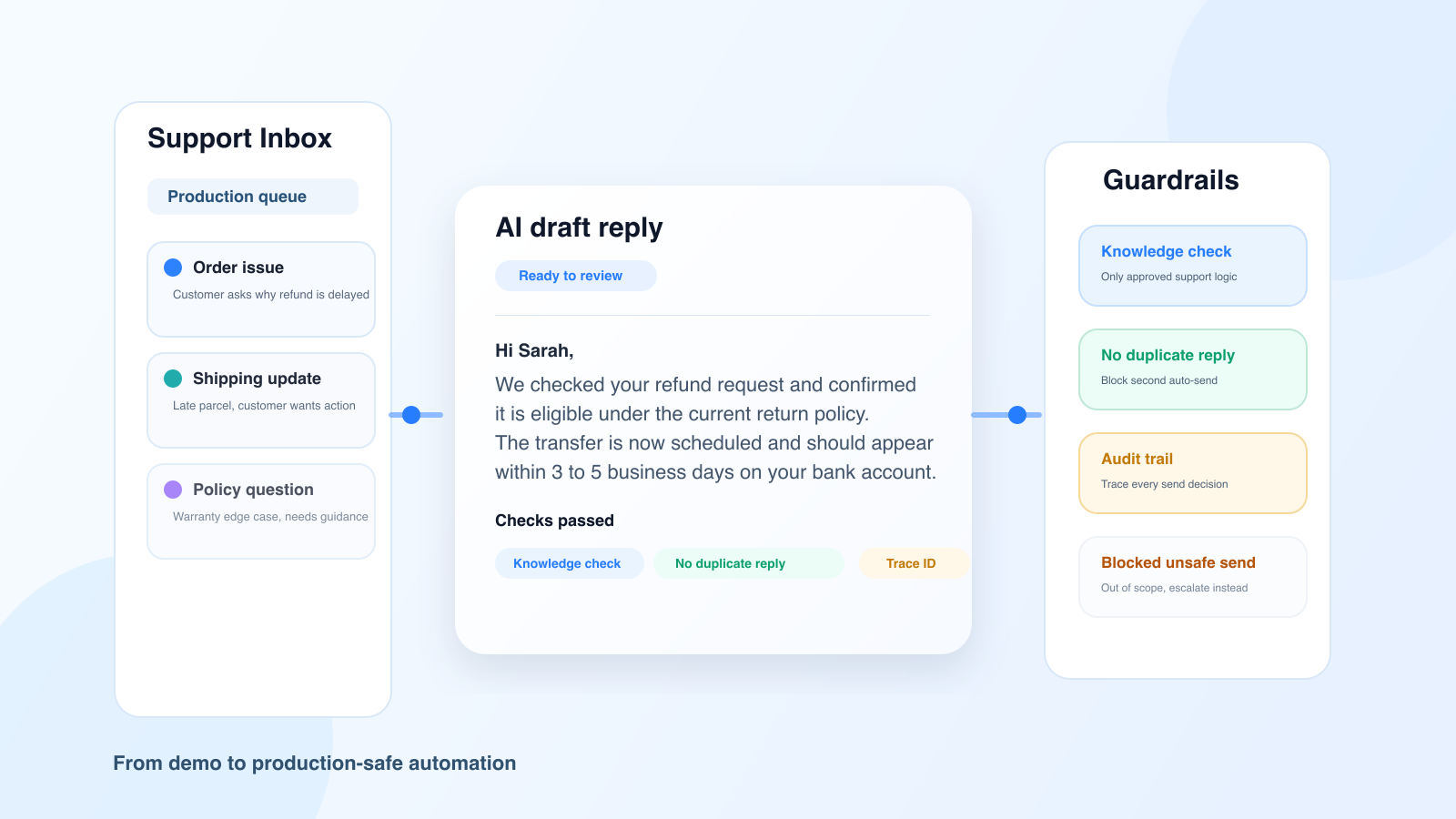

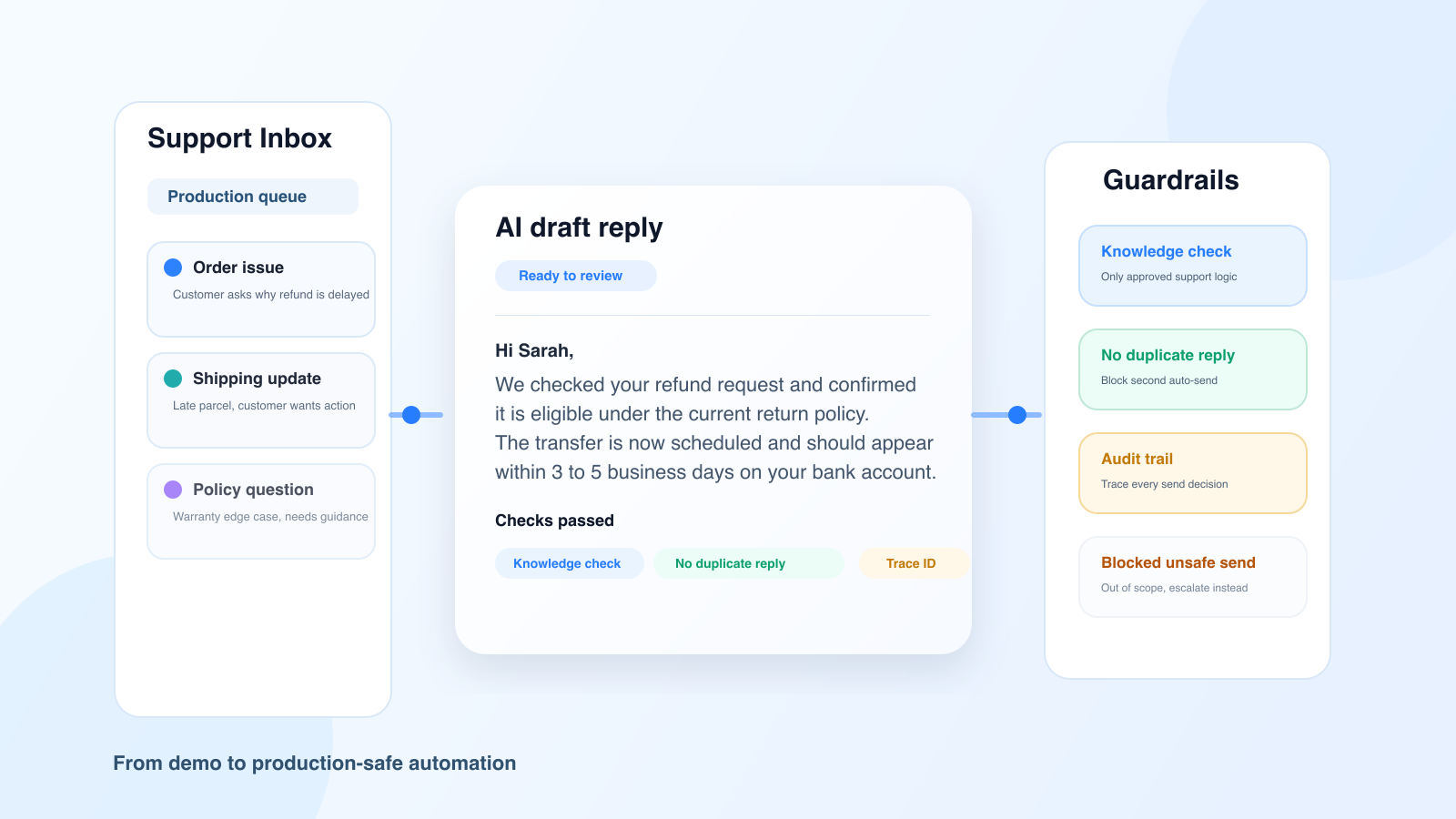

La différence entre une démo convaincante et une automatisation fiable ne tient pas à un prompt plus long. Elle tient à une architecture globale avec, notamment, des garde-fous.

En démo, le contexte est propre. Les cas sont choisis. Les exemples sont bien formés. Les erreurs apparaissent rarement.

En production, c’est l’inverse. Les tickets arrivent avec du bruit, des exceptions, des contraintes spécifiques au client et des cas où la bonne action n’est pas de répondre, mais d’escalader ou de s’abstenir.

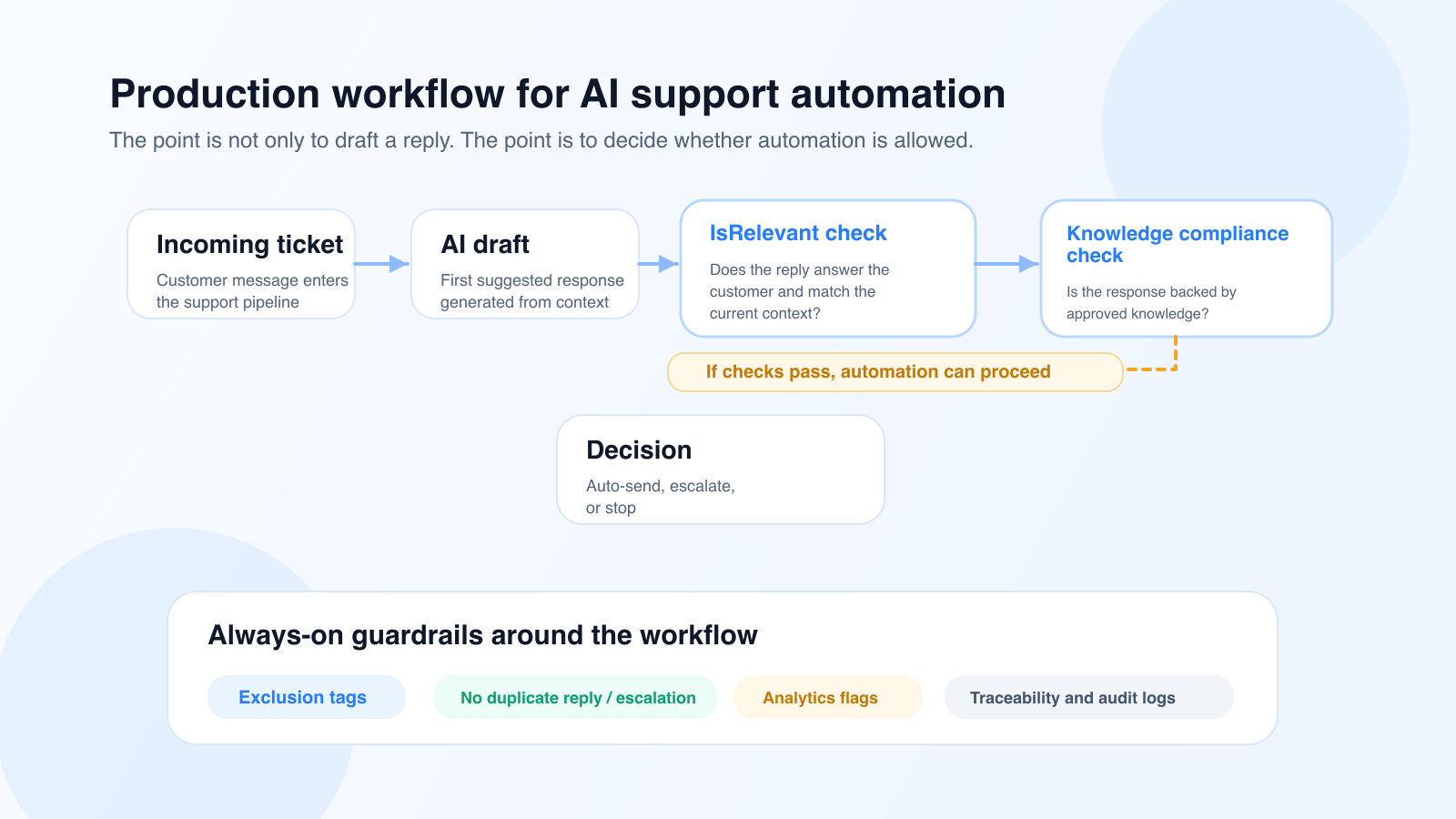

Autrement dit, une IA support performante ne se juge pas seulement à sa capacité à rédiger une bonne phrase. Elle se juge à sa capacité à savoir quand ne pas automatiser.

Le premier garde-fou n’est pas seulement de produire une réponse correcte dans l’absolu. C’est de vérifier qu’elle répond bien à la question du client, et qu’elle est alignée avec son contexte au moment précis où le ticket est traité.

Chez Klark, ce rôle estporté par notre checkpoint IsRelevant, qui vérifie si la suggestion traite réellement l’intention du client, tient compte des éléments utiles du ticket, et reste cohérente avec la situation présente. Une réponse peut être bien formulée, polie, voire plausible, tout en étant complètement hors sujet (typiquement quand le modèle LLM "hallucine").

Ce point est essentiel en production.

Avant même de se demander si une réponse est conforme à la base de connaissance, il faut s’assurer qu’elle est pertinente.

Shit in, Shit out.

Une fois la pertinence validée, le deuxième risque est simple : une réponse plausible, mais non supportée par la base de connaissance, hors process.

Chez Klark, ce sujet est géré par un checkpoint dédié, isCompliantWithKnowledge, dont le rôle est de vérifier si la réponse est directement supportée par les exemples et procédures du client. Une bonne tournure ne suffit pas, si la réponse ne peut pas être trouvée ou raisonnablement inférée depuis la connaissance validée, elle ne doit pas être envoyée.

Ce point change est vital pour les équipes support. On ne mesure plus seulement la qualité rédactionnelle d’une suggestion, mais sa légitimité opérationnelle.

Un système d’automatisation peut sembler performant jusqu’au jour où il répond deux fois au même client exactement la même chose et commence alors une boucle infinie où le client est en otage avec la machine.

Ce type d’incident dégrade très vite l’expérience client et la confiance des agents. C’est pourquoi les règles "anti-boucle" doivent faire partie du socle, c'est aussi une façon de respecter l'IA Act en laissant le contrôle au consommateur de pouvoir parler à un humain.

Concrètement, un système de support par IA doit savoir :

Ce n’est pas une finition. C’est une condition d’exploitation.

Si vous ne savez pas quelles suggestions ont été envoyées automatiquement et comment retrouver leur exécution dans les logs, vous n’avez pas vraiment une automatisation en production. Vous avez une boîte noire.

Pour piloter sérieusement une IA support, il faut au minimum :

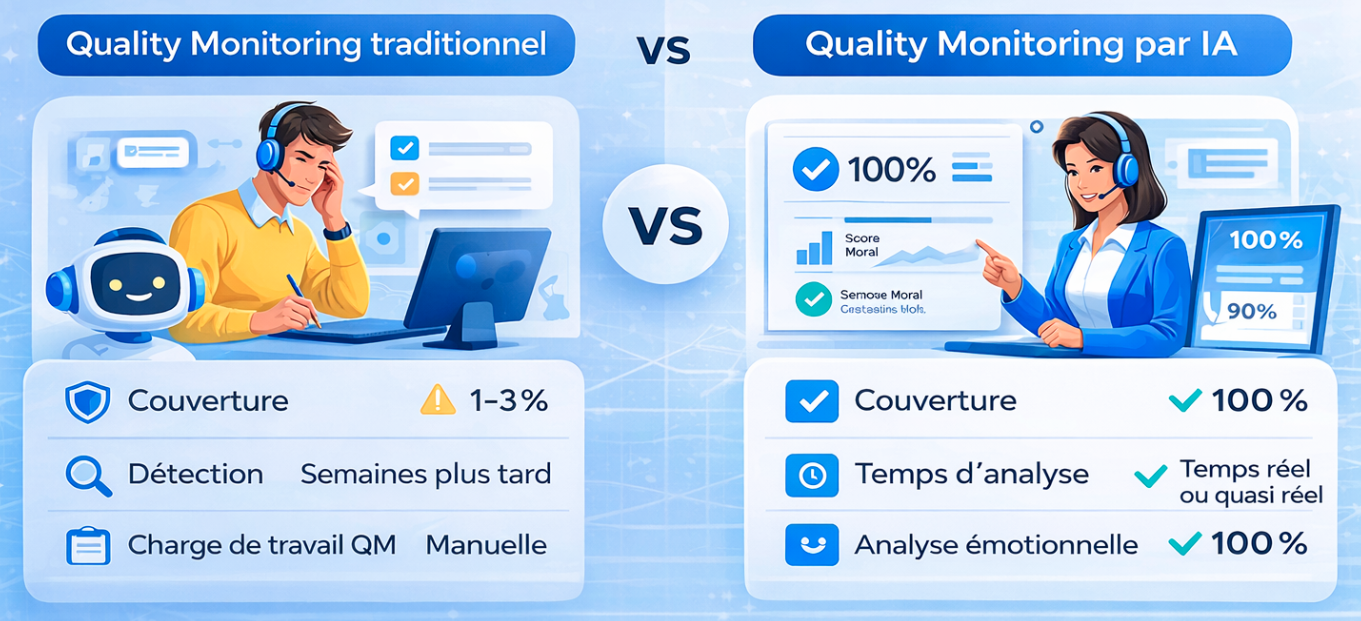

Cette couche d’observabilité change la conversation avec les équipes support et opérations. On ne parle plus d’impression générale, mais de volumes, de cas filtrés, de comportements tracés et d’améliorations mesurables.

Ces "garde-fous", c’est aussi ce qui rend l’automatisation réellement plug and play chez Klark.

Grâce à ces checkpoints, il n’est plus nécessaire de passer des semaines en ateliers pour définir manuellement tout le périmètre automatisable, valider chaque cas limite ou trier à la main les bonnes et mauvaises suggestions. Les checkpoints identifient automatiquement ce qui peut passer en auto, ce qui doit être exclu et ce qui doit rester sous contrôle humain.

C’est ce qui permet à Klark de déployer des automations à l’échelle en moins d’un mois, sur 30 % du flux, sans paramétrage côté client.

Passer à l’automatisation du support client par IA ne veut pas dire retirer les agents de la boucle. Cela veut dire déplacer leur rôle.

Au lieu de relire chaque suggestion une par une, l’équipe peut définir :

L’IA prend alors en charge les cas répétitifs et bien cadrés, tandis que l’équipe garde le contrôle sur le scope, les exceptions et les indicateurs de qualité. Cette articulation entre automatisation et assistance rejoint d’ailleurs les usages plus larges de l’IA générative pour le service client.

La plupart des entreprises demandent : « Est-ce que notre IA sait bien répondre ? »

La meilleure question est plutôt : « Quelles sont les conditions exactes dans lesquelles nous l’autorisons à répondre seule ? »

Cette nuance est décisive. Elle transforme une démo avec des paillettes en un système concret, fiable et générateur de valeur.

Avant d’ouvrir le scope d’automatisation, vérifiez que vous avez :

Sans ces briques, vous pouvez faire une belle démo. Vous ne pouvez pas encore industrialiser le support, ni atteindre le niveau d’exigence attendu d’un service client performant.

L’automatisation du support client par IA n’échoue pas en production parce que les modèles écrivent mal. Elle échoue quand l’entreprise confond génération de texte et système de décision.

La bonne approche consiste à encadrer l’IA avec des checkpoints, des retries bornés, des exclusions explicites et une vraie observabilité. C’est ce passage du « ça marche en démo » au « ça tient en production » qui crée une valeur durable pour les équipes support.

Si vous voulez déployer l’IA sur votre support sans perdre en contrôle, le point clé, c’est la gouvernance de l’automatisation. Et pour voir ce que cela donne sur un cas concret, vous pouvez aussi regarder notre cas client Octopia.

Sur le fond, cette logique rejoint aussi le NIST AI Risk Management Framework Playbook, qui structure la gestion des risques autour de fonctions comme gouverner, cartographier, mesurer et gérer.

À propos de Klark

Klark est une plateforme d’IA générative qui aide les agents du service client à répondre plus vite, plus précisément, sans changer leurs outils ni leurs habitudes. Déployable en quelques minutes, Klark est déjà utilisé par plus de 60 marques et 2 000 agents.